スキーママークアップ、なんだか難しそう?

スキーママークアップとか、構造化データとか…。よく聞かれるんですよね、これ。なんか、SEOに良いらしいけど、何から手をつければいいのか分からないって。うん、分かります。正直、ちょっととっつきにくい言葉ですよね。🤔

まあ、なんていうか…一言でいうと、「Webページに書かれている情報が『何なのか』を、検索エンジンにちゃんと教えてあげるための目印」みたいなものです。 例えば、「田中」って書いてあっても、それが人の名前なのか、地名なのか、Googleには分からない。でも、「これは人名ですよ」って目印をつけてあげると、Googleが「なるほど、著者名なんだな」と理解してくれる。ただそれだけのことなんです。

これをやると、検索結果でちょっとだけリッチな表示(リッチリザルトって言います)になったりして、クリックされやすくなるかも…というメリットがあります。 でも、直接的に順位が爆上がりする魔法じゃないので、そこは期待しすぎないのが吉です。 まずは「やったらちょっとだけお得かも」くらいの気持ちで始めるのが、精神的に楽でいいと思います。

で、やるとどんないいことがあるの?

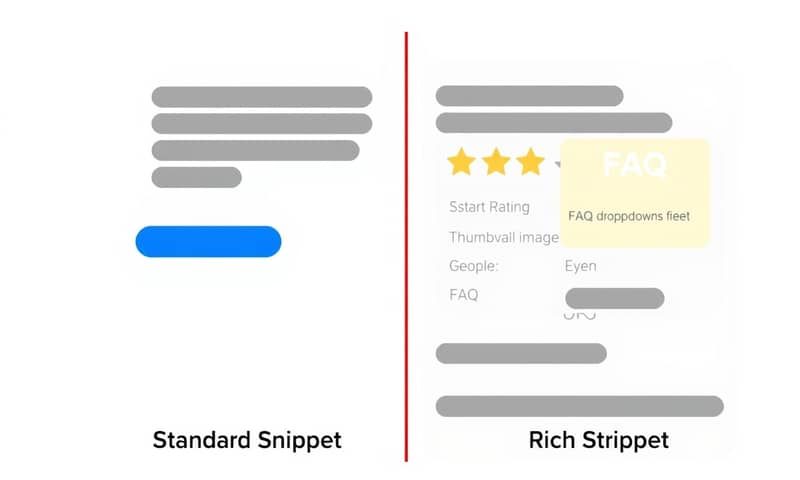

言葉で説明してもピンと来ないかもなので、見た目の話をしますね。スキーママークアップをちゃんと設定すると、検索結果がちょっとだけ「豪華」になることがあります。 これを「リッチリザルト」とか「リッチスニペット」とか呼びます。

例えば、レシピサイトなら評価の星が表示されたり、Q&Aページなら質問と答えが検索画面で直接開けたり…。見たことありますよね?あれです。普通の検索結果より目立つので、ユーザーの目に留まりやすくなって、結果的にクリック率が上がるかもしれない、ということです。

ただ、最近はGoogleの仕様変更で、例えばFAQ(よくある質問)のリッチリザルトは、すごく信頼性が高い一部のサイトにしか表示されなくなったりもしています。 なので、「設定すれば必ず表示される」わけではない、という点は覚えておいてください。 あくまで「表示される資格を得る」ための設定、という感じです。

じゃあ、具体的にどうやるの?

さて、ここからが本題ですね。実装方法って、昔はいくつか種類があって面倒だったんですが…今はもう「JSON-LD」という形式一択でいいと思います。 Googleもこの形式を推奨していますし、HTMLの見た目をいじらずに済むので、管理がすごく楽なんです。

ざっくりした手順は、こんな感じです。

- どの「タイプ」にするか決める: 自分のページが何なのか(記事?商品ページ?会社の情報?)を考えます。

- 必要な情報を集める: タイプに合わせて、どんな情報をマークアップするか決めます。(記事ならタイトル、公開日、著者名など)

- ツールを使ってコードを生成する: これが一番楽。手書きは大変なので、便利なツールを使いましょう。

- コードをサイトに貼り付ける: 生成されたコードを、ページのHTMLにコピペします。

- テストする: ちゃんとGoogleに認識されるか、テストツールで確認します。

うん、これだけです。意外とシンプルじゃないですか?一つずつ、もうちょっとだけ詳しく見ていきますね。

手順1&2:どのタイプを選んで、何を書くか

まず、自分のページに合った「タイプ」を、Schema.orgという場所で探します。 ここは、スキーママークアップで使える語彙(ボキャブラリー)のルールブックみたいなサイトです。 英語なのでちょっと面食らうかもしれませんが、よく使うものは決まっています。

- Article: ブログ記事やニュース記事。

- Product: 商品情報。価格とか在庫とか。

- BreadcrumbList: いわゆる「パンくずリスト」。

- FAQPage: よくある質問と回答のページ。

- LocalBusiness: 店舗の情報。住所や電話番号、営業時間など。

例えばブログ記事なら、「Article」タイプを選んで、その中で「headline(タイトル)」や「datePublished(公開日)」、「author(著者)」といった項目(プロパティと呼びます)を指定していく感じです。全部を完璧に埋める必要はなくて、まずは必須なもの、重要なものからでOKです。

手順3:ツールを使ってコード生成が一番楽

ここが一番の山場に思えるかもしれませんが、今は便利なツールがあるので大丈夫です。正直、手で書くのはかなり面倒ですし、ミスも増えます。 なので、素直にジェネレーター(生成ツール)を使いましょう。

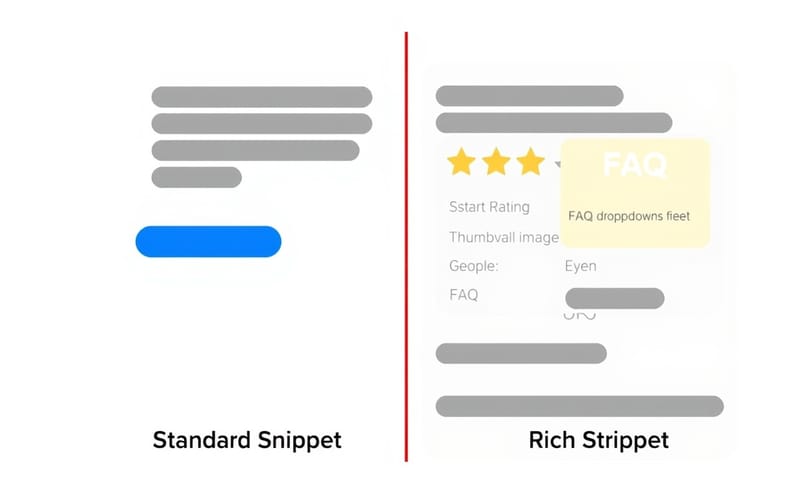

個人的によく使うのは、Merkle社の「Schema Markup Generator」です。 無料で使えて、分かりやすいのでおすすめです。

- 左のドロップダウンから、自分のページに合ったタイプ(例:Article)を選びます。

- 表示されたフォームに、ページの情報を入力していきます。(記事タイトル、URL、著者名など)

- 入力すると、右側にJSON-LD形式のコードが自動で生成されます。

- それをコピーするだけ。簡単です。👍

もちろん、Google公式の「構造化データ マークアップ支援ツール」もあります。 これも画面の指示に従って操作すればコードを作れますが、最近はちょっと情報が古かったりもするので、個人的にはMerkleのような外部ツールの方が使いやすく感じます。

手順4&5:コードの貼り付けとテスト

コードが生成できたら、あとはそれを自分のサイトのHTMLに貼り付けるだけ。JSON-LDはページのどこに置いてもいいんですが、普通はタグの中か、タグの最後の方に置くのが一般的です。 WordPressなら、専用のプラグインを使ったり、テーマの機能で簡単に入れられたりもします。

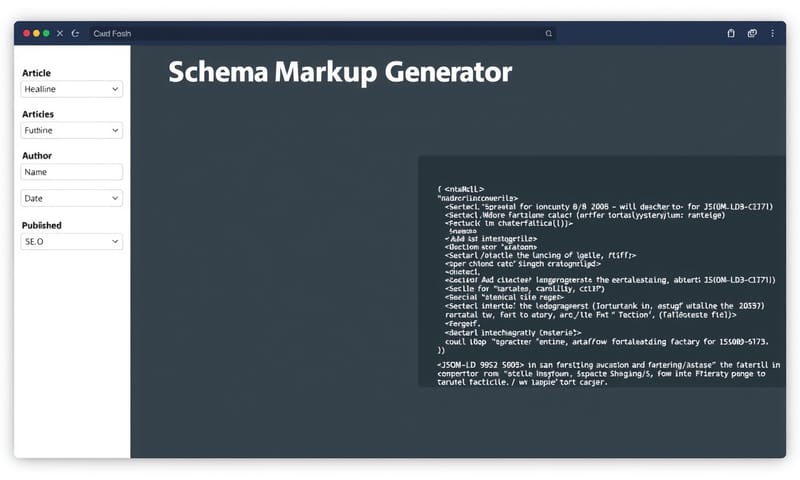

貼り付けたら、最後の仕上げにテストをします。これは必ずやりましょう。 Googleの「リッチリザルト テスト」というツールを使います。

ここにページのURLを入力して、「URLをテスト」ボタンを押すだけ。問題がなければ「ページはリッチリザルトに対応しています」と緑色のチェックマークが出ます。もしエラーが出たら、その内容を見てコードを修正します。

知っておきたい注意点とか

いくつか、心に留めておくと良いことを…。

| 注意点 | 個人的なコメント |

|---|---|

| ランキングに直接影響するわけじゃない | これをやったから順位が上がる、というよりは「検索結果で目立つチャンスを得る」って感じ。 過度な期待は禁物です。 |

| ガイドライン違反はペナルティの元 | ユーザーに見えない情報をマークアップしたり、内容と違うことを書いたりすると、Googleから手動対策(ペナルティ)を受けることがあります。 真面目にやりましょう。 |

| 表示されるかはGoogle次第 | 設定が完璧でも、表示を保証するものではありません。 あくまでGoogleが「このユーザーにはこの情報が有益だ」と判断した場合だけです。 |

| 実装後のモニタリングも大事 | 実装したら、Google Search Consoleの「拡張」レポートを見て、ちゃんと認識されているか、エラーが出ていないか、定期的にチェックすると安心です。 |

まとめ:まずは簡単なものからやってみよう

ここまで色々話してきましたが、どうでしたかね…。要するに、スキーママークアップは「検索エンジン向けの丁寧な説明書き」です。やったからといって劇的な変化があるわけじゃないけど、やっておいて損はない、という感じの施策です。

全部完璧にやろうとすると大変なので、まずは自分のサイトで一番大事なページ(例えば、主力商品のページや、一番読まれているブログ記事)から、簡単なタイプ(ProductやArticle)で試してみるのが良いんじゃないかなと思います。一度やってみれば、思ったより難しくないって分かるはずです。🙏

皆さんは、もしやるとしたら、どのページからスキーママークアップを試してみたいですか?あるいは、もうやってるよ!という方は、どんな効果を感じましたか?よかったら教えてください。