コアウェブバイタル、どのツールで見る?

コアウェブバイタル(CWV)。大事だとは言うけど、ツールによって数値が違う。PageSpeed InsightsとSearch Consoleで、なんでスコアが食い違うのか…。正直、この数値に一喜一憂するのも疲れる。結局、どのツールを信じればいいのか。それが問題。

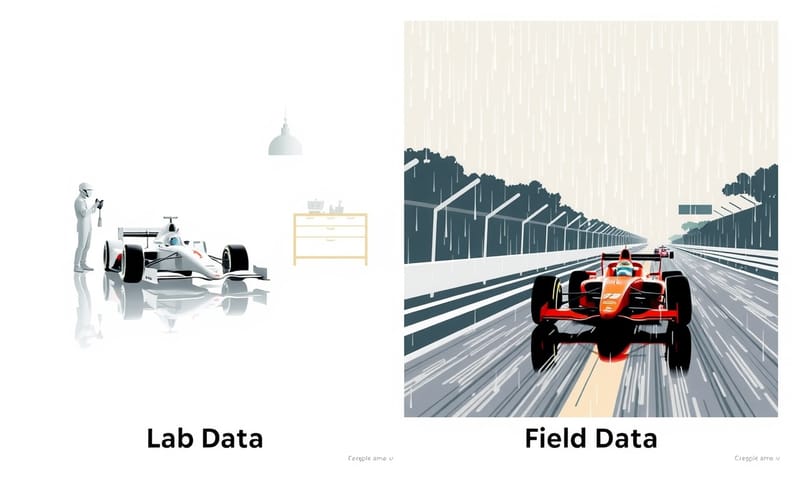

ポイントは、データの「種類」みたいだ。ラボデータとフィールドデータ。この2つの違いを分かってないと、ツールの数字に振り回されるだけになる。

ラボデータとフィールドデータ:そもそも何が違うのか

この違いが、たぶん一番大事。ちょっと整理してみる。

- ラボデータ(Lab Data):これは「実験室」のデータ。 PageSpeed InsightsでURLを入れてすぐ出てくるスコアとか、Lighthouseで計測するやつがこれ。 決まった環境(特定のデバイス、回線速度)で「もし、こんなユーザーが来たら…」をシミュレーションしてる。 だから、何回やっても大体同じ結果が出るし、改善前後の比較がしやすい。 デバッグには便利。

- フィールドデータ(Field Data):こっちは「現場」のデータ。 RUM(Real User Monitoring)とも言う。 実際にサイトを訪れたChromeユーザーの、生々しい体験データ。 いろんなデバイス、いろんなネット環境、いろんな国のユーザーが混ざってる。 Google Search Consoleのコアウェブバイタルレポートは、こっち。PageSpeed Insightsにも「実際のユーザーの環境で評価する」って項目がある。

で、重要なのは、Googleがランキングで参考にするのは、この「フィールドデータ」の方だけ、ということ。 ラボのスコアがいくら良くても、実際のユーザー体験が悪ければ意味がない、というGoogleの考え方らしい。 まぁ、当然と言えば当然か。

主要な測定ツール、それぞれの立ち位置

じゃあ、具体的にどのツールが何をしてくれるのか。いつも使うやつを並べてみる。

| ツール名 | データ種類 | 個人的な使いどころ・所感 |

|---|---|---|

| PageSpeed Insights | フィールド + ラボ | 一番手軽。URL入れるだけ。 フィールドデータで現実を知り、ラボデータで改善のヒントを探る、みたいな。両方見れるのが良い。 でも、海外サーバーからの計測だからか、日本のサイトはスコアが辛めに出る気がする。 |

| Google Search Console | フィールドのみ | サイト全体で「不良」「改善が必要」なURLを教えてくれる。 日々の健康診断はこれ。ただ、データが過去28日間の集計だから、修正が反映されるまで時間がかかる。 すぐに結果が見たいときには向かない。 |

| Lighthouse | ラボのみ | Chromeの開発者ツールに入ってるやつ。 パフォーマンスだけじゃなく、SEOやアクセシビリティも見てくれる。 ローカル環境やテスト環境のページも計測できるのが強み。 開発中に細かくチェックするのに使う感じ。 |

| Web Vitals 拡張機能 | リアルタイム(ラボ寄り) | Chromeの拡張機能。 表示してるページをリアルタイムで計測してくれるから、ちょっとした変更がどう影響するか、すぐに確認できて便利。 オーバーレイで常に表示させておける。 |

「改善提案」の質も大事なポイント

ツールはスコアを出すだけじゃなくて、「これを直しなさい」って提案もしてくれる。 でも、この提案がまたクセモノで。

例えば「使用していないJavaScriptを削除してください」とか「画像を次世代フォーマットで配信してください」とか。…言われなくても分かってる、ということが多い。それが簡単にできれば苦労しないわけで。

ここで差が出るのが、提案の具体性。一部の有料ツールや、GTmetrixみたいな海外のツールだと、どのリソースがどれだけ読み込みをブロックしてるか、ウォーターフォールチャートで視覚的に見せてくれたりする。 こういうのが、本当に原因を特定したいときには役立つ。PageSpeed Insightsの提案は、どちらかというと一般的なベストプラクティスが多い印象。 まずはPSIで全体像を掴んで、深く掘りたくなったら専門的なツールを使う、という流れがいいのかもしれない。

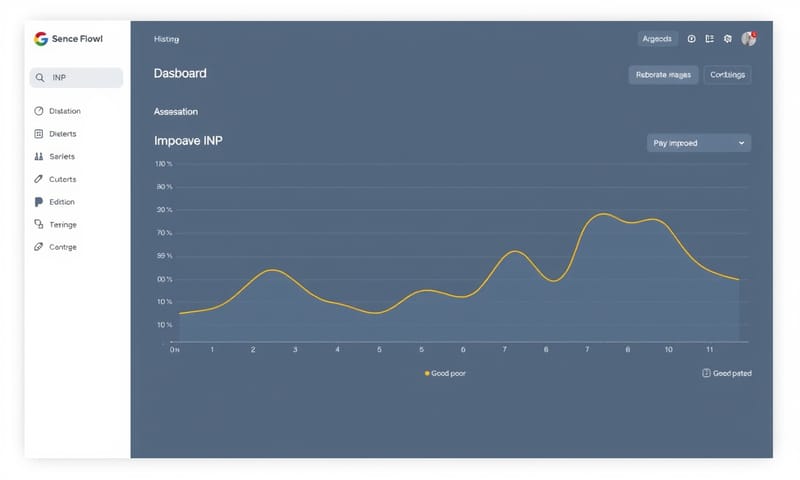

忘れてはいけない、INPの存在

そういえば、2024年3月からFID(First Input Delay)がINP(Interaction to Next Paint)に置き換わった。 FIDは最初のインタラクションだけが対象だったけど、INPはページの閲覧中に発生するすべてのクリックやタップへの応答性を測る。 よりユーザー体験全体を反映する指標になった、ということ。 これ、まだ古い情報のままの解説サイトも多いから注意が必要だ。当然、これからの最適化はINPを意識しないといけない。

測定場所による精度の違い:日本のサイトを海外から測る意味

もう一つ、気になるのが測定サーバーの場所。PageSpeed InsightsはGoogleのサーバーから計測するけど、その場所は公開されていない。GTmetrixみたいなツールは、カナダとかアメリカとか、いくつかの拠点から選べる。 当然、日本のサーバーにあるサイトをカナダから計測すれば、物理的な距離で遅延は大きくなる。

日本のユーザーだけを対象にしたサイトなら、本当は東京のサーバーから計測するのが一番リアルに近い。GTmetrixの有料版や他のいくつかのツールでは東京リージョンが使える。 この「測定場所」という視点は、ツールの精度を考える上で意外と見落としがち。特にグローバルなツールを使うときは、結果を鵜呑みにせず、あくまで参考値として捉えるのが良さそう。

結局、どのツールとどう付き合うか

結論みたいなものだけど、一つの「完璧なツール」は無い、ということなんだと思う。それぞれ役割が違うから、使い分けるしかない。

- 日常の健康診断:Google Search Consoleで「不良」URLがないか定期的にチェック。

- 改善のきっかけ探し:PageSpeed Insightsで個別のページのスコアと改善項目をざっくり把握。

- 開発・改修時の詳細分析:LighthouseやChrome DevToolsで、技術的なボトルネックを特定。

- リアルなユーザー体験の深掘り:本気でやるなら、Datadog RUMみたいな有料のリアルユーザーモニタリングツールを導入して、どんなユーザーがどこで詰まっているかを分析する。

大事なのは、ラボデータのスコアを上げること自体が目的にならないようにすること。 あくまで目標は、フィールドデータ、つまり実際のユーザー体験を良くすること。そのために、各ツールの特性を理解して、うまく使いこなしていく、というスタンスが求められるんだろうな。なかなか大変だけど。

あなたのサイトでは、コアウェブバイタルのスコア、気にしてますか?それとも、もっと大事なことがあると思いますか?よかったら意見を聞かせてください。