最初に結論。URLはシンプルが一番。

URL構造。結局、どうすればいいのか。…考えたけど、要は「シンプルで、わかりやすい」のが一番だね。 ユーザーにとっても、Googleにとっても。

キーワードを入れるのは良い。 でも、詰め込みすぎはダメ。 長いIDとか、意味不明なパラメータも避けるべき。 これが基本線。

他の記事で見落とされがちなポイント

いろいろ調べてみたけど、どの記事も似たような話が多い。…「短くしろ」「キーワードを入れろ」「ハイフンを使え」とか。 もちろん大事だけど、もっと突っ込んだ話があまりない。

例えば、日本語URL。メリットもあるけど、コピーした時にすごく長くなったり(エンコード)、文字化けしたりする。 SNSでシェアされにくいとか、被リンク受けにくいとか、そういうデメリットの話はもっとすべき。 特に海外向けのサイトだと、日本語URLは致命的になる可能性もある。 日本人向けって割り切れるならいいんだけどね。

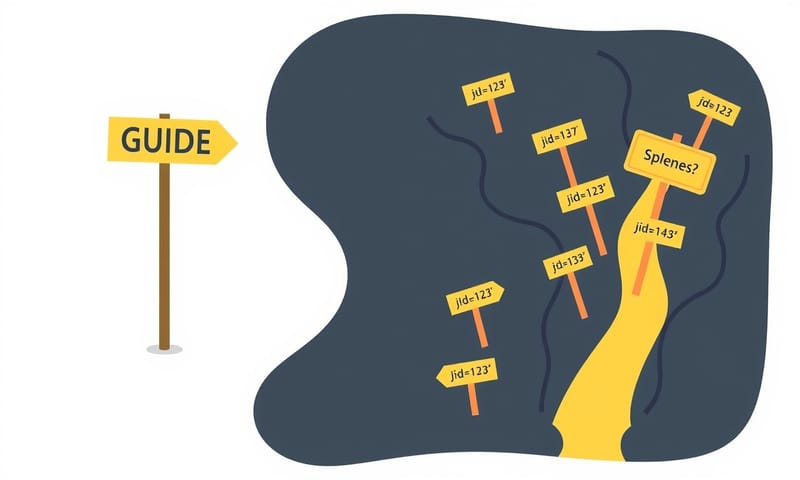

あと、CMS…WordPressとかで、実際どう設定するのか。理論だけじゃなくて、実装の手順。ここが抜けてることが多い気がする。パーマリンク設定の話とか。

一番大事なのは、URLを「後から変更する」リスク。評価がリセットされる可能性もあるし、301リダイレクトは必須。 この辺りのリスク管理の話が、意外と少ない。

SEOに優しいURLの作り方【実装手順】

じゃあ、具体的にどう作るか。手順をメモしておく。

- キーワードを決める:まず、そのページで狙うキーワードを1つ、2つ選ぶ。コンテンツの内容と合っていることが大前提。

- 英単語にする:決めたキーワードを、意味が通じる簡単な英単語にする。例えば「SEO 優しい URL 作り方」なら `seo-friendly-url` みたいな感じ。Google翻訳で十分。

- ハイフンでつなぐ:単語と単語の間は、アンダースコア `_` じゃなくてハイフン `-` でつなぐ。Googleが推奨してるやり方。

- 階層を考える:サイト全体の構造を意識する。例えば、ブログ記事なら `/blog/seo-friendly-url` のように、カテゴリの下に置く。階層は深くしすぎないこと。3階層、多くても4階層くらいがいい。 トップページから2、3クリックでたどり着けるのが理想。

- 最終チェック:出来上がったURLを見て、短く、意味がわかるか確認する。 `example.com/blog/how-to-make-seo-friendly-url-for-beginner-2025`みたいに長くなるなら、`example.com/blog/seo-friendly-url` のように削る。

良いURLと悪いURLの比較

頭でわかっていても、具体例がないとピンとこない。なので、いくつかパターンを比較しておく。

| 種類 | 良い例 (`good-example`) | 悪い例 (`bad-example`) | 個人的な所感 |

|---|---|---|---|

| ブログ記事 | /blog/seo-url-structure | /p_id=5891&category=12 | IDとかパラメータだけのやつ、ほんと意味不明。中身が全く想像できない。 |

| ECサイト商品 | /products/running-shoes-men | /item/product.php?item_cd=99823B | 階層がちゃんとしてると、ユーザーも自分がサイトのどこにいるか分かりやすいよね。 パンくずリストとも連携するし。 |

| 日本語URL | /blog/seo対策 | /blog/%E3%83%97%E3%83%AC%E3%82%BC%E3%83%B3%E3%83%88 | 表示は日本語でも、コピペするとエンコードされてこうなる。怪しく見えるし、長い。 よっぽどの理由がなければ英語がいい。 |

| キーワード詰め込み | /service/seo-consulting | /seo-ranking-up-consulting-service-tokyo | 昔はこういうのあったけど、今は逆効果な気がする。やりすぎ感が出て、ユーザーもちょっと引く。シンプルが一番。 |

海外と日本の違い:Google公式の見解

日本のSEOブログだと「日本語URLもクリック率上がるかも」みたいな話もあるけど、これは結構、日本国内に限った話だと思う。 ユーザーが日本人だけなら、まあ分からなくもない。

でも、Google本家の「検索セントラル」のドキュメントを見ると、もっと原理原則的な話が多い。 例えば、「単語はハイフンで区切る」「パラメータは少なく」とか。 ここで大事なのは、彼らが「言語に依存しない、グローバルなベストプラクティス」を推奨していること。

日本語URLは、UTF-8でエンコードしないといけないから、厳密にはASCIIじゃない。 Googleは処理できるけど、システムによっては不具合の原因になる。 だから、迷ったらGoogleの公式ドキュメントに従って、シンプルな英単語ベースにしとくのが一番安全。これが結論だね。

リスクと注意点:URL変更は慎重に

一番怖いのが、既存サイトのURLを変えるとき。軽い気持ちでやると、マジで痛い目を見る。

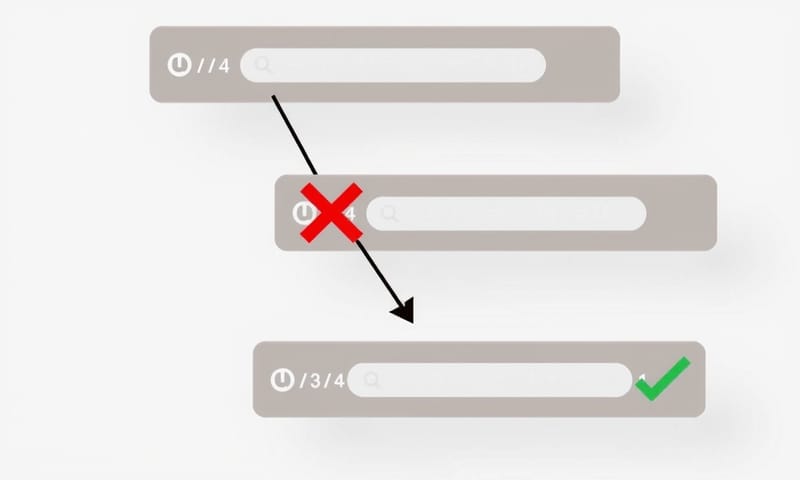

- SEO評価の喪失:URLを変えると、Googleはそのページを「新しいページ」として認識し直す可能性がある。 これまで積み上げてきた評価が一時的に、あるいは永久に失われるリスクがある。

- 被リンク切れ:外部サイトから貼ってもらったリンクが、全部リンク切れになる。これは大きな損失。

- 301リダイレクトは必須:どうしてもURLを変えるなら、古いURLから新しいURLへ「301リダイレクト」を必ず設定する。これを忘れると、ユーザーもクローラーも新しいページにたどり着けない。

- サイトマップの更新:URLを変更したら、XMLサイトマップも更新して、Search Consoleから再送信する必要がある。Googleに「変わったよ」って知らせるため。

だから、サイトを作る最初の段階で、URL構造をしっかり設計しておくのが本当に重要。後から直すのは、コストもリスクも高い。

URL設計って、地味だけど、サイトの土台になる部分。家で言えば基礎工事みたいなものかな。後から変更するのは大変だから、最初にちゃんとやっておくべき。ユーザーが迷わないように、検索エンジンが迷わないように。結局、そこに尽きる。